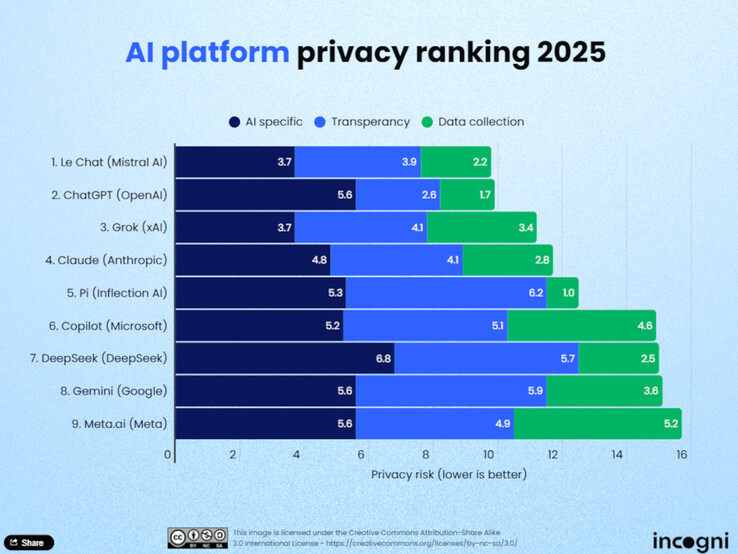

Использование искусственного интеллекта (ИИ) в повседневной жизни растет, а вместе с ним растет и важность защиты данных. Аналитики по защите данных из компании Incogni недавно провели оценку девяти ведущих больших языковых моделей (Large Language Models, LLM), чтобы определить, какие платформы в наибольшей степени соблюдают конфиденциальность пользователей. В исследовании модели ИИ оценивались по одиннадцати критериям, разделенным на три основные категории: сбор данных для обучения, прозрачность, использование и передача данных.

Лучшие рейтинги

Le Chat от Mistral AI возглавляет рейтинг. По словам Инкогни, эта модель собирает сравнительно немного данных о пользователях и предлагает очень эффективный подход к работе с данными, как на этапе обучения, так и в реальной работе. За ним следует ChatGPT от OpenAI, который в первую очередь набирает очки за свою прозрачность. Пользователи могут указать в своем аккаунте, могут ли их чаты быть использованы для дальнейшего развития модели, а если история отключена, то хранение данных предотвращается. Grok от xAI занимает третье место, также впечатляя своей прозрачной практикой защиты данных.

Последнее место в рейтинге

В самом низу рейтинга находятся Meta AI, Gemini от Google и Copilot от Microsoft. По мнению Incogni, эти платформы собирают обширные данные, не предлагая пользователям четких вариантов отказа от их использования. DeepSeek, китайская модель, также показала низкие результаты. Эти провайдеры не предлагают четких вариантов исключения пользовательских данных из обучения.

Методология

Аналитики Incogni оценивали платформы по одиннадцати критериям, разделенным на три категории: сбор данных для обучения, прозрачность, а также использование и обмен данными. На категорию "использование и обмен данными" пришлось 50% общего рейтинга, на "прозрачность" - 30%, а на "данные для обучения" - 20%. Только четыре из девяти протестированных инструментов позволяют пользователям активно исключать свои данные из обучения.

Заключение

Исследование показывает, что защита данных еще не везде является стандартом в мире ИИ. Поэтому пользователям следует активно знакомиться с политикой конфиденциальности поставщиков, особенно когда речь идет о конфиденциальном контенте, конфиденциальной информации о клиентах или личных данных. Те, кто ценит защиту данных, найдут приемлемые варианты в Le Chat, ChatGPT или Grok. Однако по-настоящему эффективные в плане защиты данных LLM в 2025 году все еще будут исключением